Cassandra Crossing/ Intelligenze Artificiali: fabbriche di informazioni false (2)

Questo è un articolo su più pagine: ti invitiamo a leggere la pagina iniziale

Intelligenze Artificiali, fabbriche di informazioni false

E veniamo finalmente all’attualità. Un software prodotto dall’azienda OpenAI, chiamato GPT-3 (Generative pre-Trained Transformer) — Trasformatore generativo pre-allenato, dopo essere stato nutrito con una quantità enorme di dati si è rivelato particolarmente efficace nel generare risposte credibili, ed è stato messo a disposizione del pubblico tramite un’interfaccia colloquiale chiamata ChatGPT.

ChatGPT ha avuto un’enorme risonanza, e moltissime persone, dopo averla provata, hanno cominciato a scrivere cose indicibili, minchiate galattiche, descrizioni tanto fantasiose quanto errate su questo software, sui suoi successori e sulle tecnologia alla loro base, descrivendola come il futuro paradiso dell’umanità, come la soluzione a tutti i problemi. Come oracoli di verità.

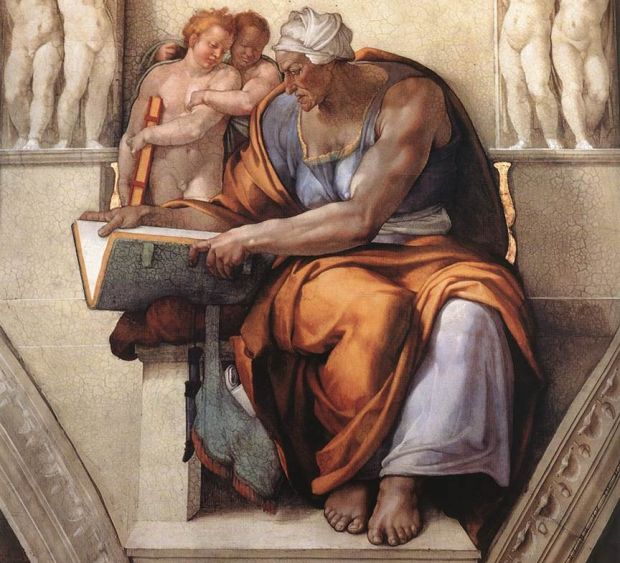

Se questo articolo di Cassandra fosse un romanzo giallo, a questo punto il lettore attento potrebbe già individuare l’assassino. Ma continuiamo nella storia, e arriviamo al finale. Cassandra, come profetessa, ha frequentato gli oracoli, e ne ha sperimentato tutti i limiti.

Articoli raccomandati:

Un famoso responso fornito da un oracolo, la Sibilla romana, a un soldato in procinto di partire per la guerra, che voleva sapere se ne sarebbe tornato, fu “Ibis, redibis non morieris in bello“.

Per chi non avesse avuto frequentazioni con la lingua latina, la sequenza di sei parole, mancando di una virgola, poteva significare sia quello che il soldato voleva sentirsi dire “Partirai, tornerai, non morirai in guerra”, sia il suo opposto “Partirai, non tornerai, morirai in guerra”. Non conteneva nessuna informazione. Era una “non-risposta”. Un risposta priva di significato e di informazione, ma a cui il soldato fornì il significato che desiderava, cioè che sarebbe sopravvissuto, e non quello che sarebbe morto in guerra. Ma qualcuno potrebbe pensare che l’oracolo conoscesse davvero il futuro, e si divertisse malignamente a renderlo comunque oscuro ai poveri mortali.

Così certamente non è per ChatGPT, perché questo software non solo non conosce il futuro, ma nemmeno conosce la risposta a nessuna domanda, nemmeno se una foto sia di un gatto oppure no. ChatGPT e tutti i suoi successori dello stesso tipo non conoscono, non conoscono per niente, non conoscono assolutamente, non conoscono neanche lontanamente la risposta a qualsiasi domanda; non conoscono assolutamente nulla.

Per approfondire:

La conoscenza con cui vengono “nutriti” viene “digerita” e svanisce, lasciando solo un credibile “Mentecatto Artificiale” privo di qualsiasi Intelligenza o Cultura. ChatGPT e tutti i suoi successori sono fatti solo e unicamente per generare risposte “credibili” a domande poste in linguaggio naturale. Risposte credibili, non risposte vere.

Questo concetto deve essere recitato come un mantra, ripetuto fino allo sfinimento, pubblicizzato in ogni occasione: ChatGPT e tutti i suoi successori non hanno nessuna conoscenza sulla verità o falsità di una domanda, non hanno nessuna cultura, pur avendone digerito quantità enormi. Sono un vicolo cieco, utilizzabile solo come arma di propaganda di massa. E lo stanno facendo! Sono solo in grado di darvi risposte credibili, in cui voi individuerete il significato che volete o potete dargli.

Sullo stesso tema:

E qui sta il pericolo: questi oggetti vengono propagandati come risponditori di domande, non come affabulatori o generatori di prosa fantasiosa. E la loro attuale linea di sviluppo non è quella di renderli capaci di risposte esatte, cosa che non sarà mai possibile, ma solo incapaci di dare risposte così errate da essere evidenti o ridicole, risposte che siano espresse in termini razzisti, sessisti, in violazione di qualsiasi possibile concetto “politically correct“.

Non c’è quindi nessuna possibilità, se non per puro caso, di avere risposte informate e corrette da modelli linguistici, cioè da software come GPT-3, ChatGPT, GPT-4 e i loro fratelli e successori. Non sono fatti per questo. Non lo sanno e non lo possono fare per progetto. Non conoscono, e non sanno calcolare, categorie come “verità” o “esattezza”. È assolutamente impossibile che forniscano risposte esatte e affidabili, per quanti “miglioramenti” e filtri vi vengano aggiunti.

Nel frattempo la maggioranza del pubblico, indotta in errore da un’attività di propaganda commerciale che non si è mai vista nel mondo delle tecnologie informatiche, è convinta di interagire con un software che può fornire vere risposte, mentre in realtà è in grado di fornire solo sequenze di parole ben formate, ma assolutamente vuote di qualsiasi contenuto affidabile. Parole messe a caso ma con grande proprietà di linguaggio.

Ti raccomandiamo anche:

Potrei dire che possono produrre solo discorsi da politicanti e venditori di auto usate, ma fate conto che non l’abbia detto. Speriamo che questa ennesima ripetizione, spero ben argomentata ripetizione, serva a qualcosa.

Se vi affidate a ChatGPT, non tornerete mai dalla guerra.

Articoli suggeriti: